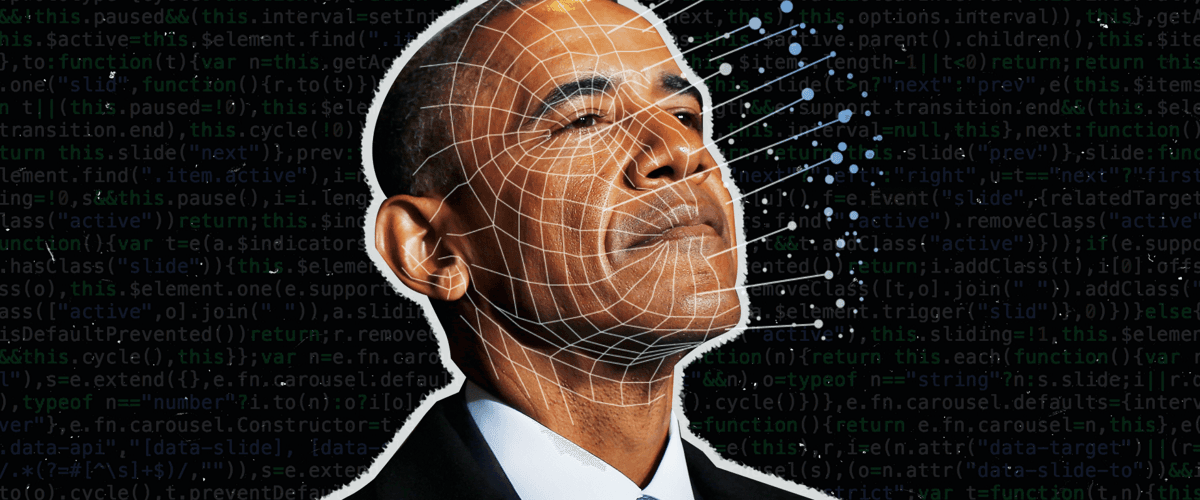

По прогнозу одного из ведущих специалистов в области дипфейков Хао Ли, поддельные видео станут неотличимыми от реальности в течение 6-12 месяцев, то есть, скорее всего, в самый разгар предвыборной кампании в США. Хао Ли сейчас работает над созданием «детектора дипфейков». Однако эксперты MIT Tech Review уверены, что даже если он преуспеет, связанные с использованием технологии угрозы это не устранит.

Плашка «дипфейк» на любом отредактированном видео не купирует последствия, которые оно порождает, указывают они. В этом случае новые технологии сами по себе бессильны.

Главные последствия дипфейков — дезинформация и харрасмент, указывает в своем исследовании «Данные и общество» эксперт Университета Рутгерса Бритт Пэрис. И даже идеальный дипфейк-детектор тут бессилен.

1. Детектор не подскажет, какое видео следует удалить, а какое — оставить

Одно из самых резонансных для США отредактированных видео вовсе не было дипфейком. Речь идет о замедленном фрагменте речи Ненси Пелоси — главы нижней палаты Конгресса США, одного из самых влиятельных политиков в стране. Пелоси выглядела на нем пьяной, но Facebook отказалась удалять материал из выдачи — ведь ни одним фрагментом изображения не манипулировали. «Чем больше вы задействуете алгоритмы, тем выше риск ошибки. Определение сатиры, фейковых новостей или фантастики — это вопрос философский», — говорит профессор Кейт Клоник, эксперт по управлению платформами и соцсетями.

Возможный выход: переосмысление работы модератора. Им надо платить больше и готовить лучше, потому что только человек может оценить контент с учетом его потенциального воздействия на социальную и политическую жизнь. Модератор посмеется над Михаилом Ефремовым в «Ангелах Чарли», но быстро вычистит высокотехнологичную порноместь. Кроме того, платформы должны упростить подачу жалоб на дипфейк-харрасмент.

2. Распознавание дипфейков срабатывает слишком поздно

Интернет облегчил распространение информации и сделал практически невозможным ее ограничение. Крайне сложно убрать из Сети то, что туда однажды попало. Законодательство пока не готово ответить на вызовы нового времени.

Кара за распространение данных из медкарт — правдивой информации — серьезно превышает последствия от тиражирования вредящего репутации поддельного видео. А они могут быть не менее тяжелыми.

Есть законы о наказании за ущерб репутации — но что делать с видео, если они представляют человека в ложном, но позитивном свете? Мы веселимся, наблюдая, как «Киану Ривз» предотвращает ограбление, но дипфейки могут вывести политическую пропаганду на невиданный ранее уровень.

Решить эту проблему, очевидно, могут новые законы. Но в таком случае единого решения не будет — как минимум, они будут отличаться на уровне государств. А в США бурное обсуждение идет на уровне отдельных Штатов. Этого, как подчеркивает MIT Tech Revew, недостаточно, так как в Штатах платформы несут уголовную ответственность лишь за размещение контента, нарушающего федеральное законодательство.

3. Разоблачение дипфейков не поможет тем, кому это нужно больше всего

История свидетельствует, что новую технологию на первом этапе используют против маргинализированных групп — женщин, активистов, ЛГБТ, напоминает Пэрис. Еще в 90-х любители «Фотошопа» пририсовывали головы женщин к телам актрис из фильмов для взрослых. «Если бы мы тогда отреагировали на проблему сексуальной эксплуатации женщин без их согласия, сейчас наши позиции были бы гораздо крепче», — подчеркнул эксперт.

Дипфейки гораздо больше навредят рядовым гражданам, а не политикам, но говорить все будут лишь об известных людях.

Эту проблему решить еще сложнее, ведь у людей из социально незащищенных слоев зачастую вовсе нет представителя в таких вопросах. Пресса может решить отдельный конфликт, раздув шумиху, но не создать инфраструктуру и механизм взаимодействия.

И это универсальная проблема: обществу будущего предстоит придумать, как при разработке учесть интересы тех, на кого новая технология влияет сильнее всего.

Недавно Хайтек+ взял интервью у одного из ведущих российских футурологов Сергея Переслегина. Он уверен, что ИИ не будет захватывать мир, но и контролировать его не получится. И человечество вступит в эру нового эволюционного соревнования.