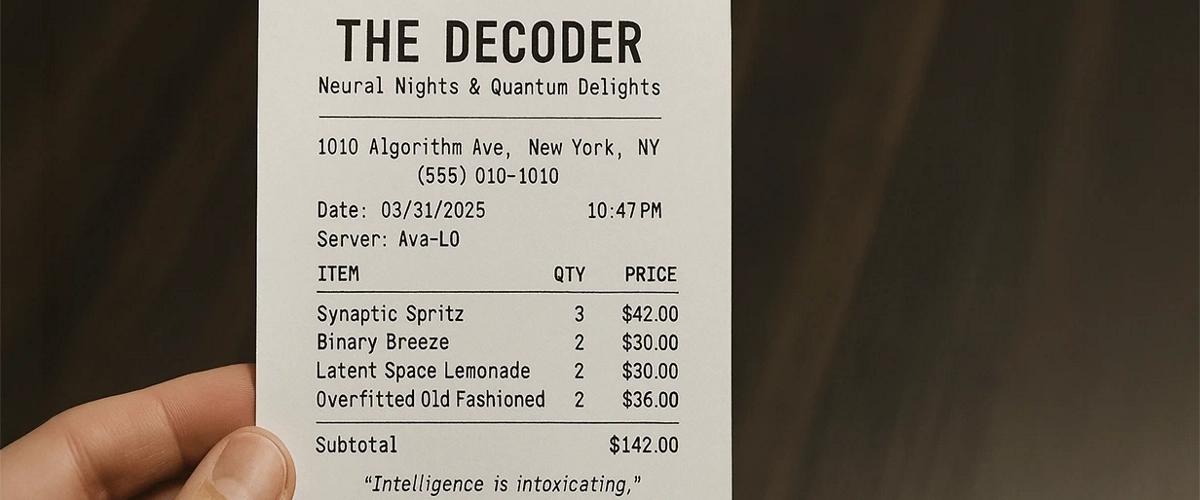

Венчурный инвестор и блогер Диди Дас опубликовал в X фальшивый чек из реального стейк-хауса в Сан-Франциско, который, по его словам, был создан в ChatGPT-4o. Другим пользователям также удалось воспроизвести подобные результаты — некоторые даже добавляли пятна от еды и напитков, чтобы чеки выглядели максимально реалистично. Наиболее правдоподобный пример, найденный TechCrunch, был родом из Франции: пользователь LinkedIn разместил смятый сгенерированный чек местной ресторанной сети.

Журналисты TechCrunch решили сами протестировать 4o. Они создали поддельный чек ресторана Applebee’s в Сан-Франциско. Однако в их случае фальшивку легко было распознать. Во-первых, в общей сумме вместо точки использовалась запятая. Во-вторых, итоговые расчеты не сходились. Это неудивительно — языковые модели по-прежнему плохо справляются с простейшей арифметикой.

Однако мошенникам не составит труда подправить цифры с помощью фоторедактора или более точных запросов к ИИ. Очевидно, что простота создания поддельных чеков открывает огромные возможности для злоупотребления. Например, эту технологию могут использовать для получения «компенсаций» за несуществующие расходы.

Представитель OpenAI Тайя Кристиансон сообщила, что все изображения от ChatGPT содержат специальные метаданные, которые указывают на их искусственное происхождение. Она также отметила, что компания следит за соблюдением правил использования платформы и принимает меры при нарушениях. OpenAI постоянно анализирует реальные случаи применения технологии и получает обратную связь от пользователей.

TechCrunch поинтересовался, почему ChatGPT вообще позволяет создавать поддельные чеки и соответствует ли это политике OpenAI, которая запрещает мошенничество. Кристиансон ответила, что цель OpenAI — «обеспечить пользователям максимальную творческую свободу». По ее словам, фальшивые ИИ-чеки могут иметь легальное применение — например, для обучения финансовой грамотности, создания рекламных материалов или арт-проектов.