3D-моделирование применяется во многих сферах. CGI-эффекты используются в современных кино, видеоиграх, AR и VR или при создании карт лунных кратеров NASA. Технологию активно использует Google — вся концепция метавселенной строится на использовании 3D-графики. Но создание трёхмерных изображений — ресурсоемкий процесс, занимающий много машинного времени, несмотря на попытки компаний ускорить развитие отрасли. Так, NVIDIA пыталась автоматизировать генерацию объектов, а Epic Game создала мобильное приложение RealityCapture, которое позволяет любому пользователю iOS сканировать объекты реального мира в виде 3D-изображений.

В последнее время популярность завоевали генераторы изображений по текстовым описаниям: DALL-E 2 и Craiyon компании OpenAI, DeepAI, Lensa разработки Prisma Labs или Stable Diffusion компании HuggingFace. Преобразование текста в 3D является ответвлением этого тренда.

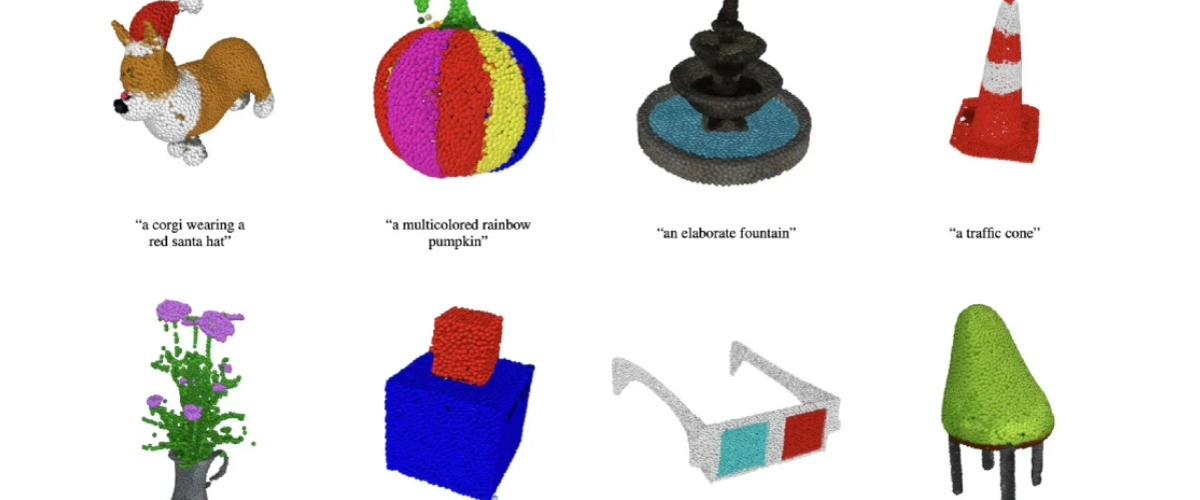

Для создания трехмерного объекта по описанию нейросеть POINT-E сначала создает обычное изображение на основе текста, после чего, базируясь на изображении, генерирует 3D-облако точек. Это происходит за секунды и не требует дорогостоящей оптимизации. Например, если ввести «кот, поедающий буррито» (a cat eating a burrito), POINT-E сначала сгенерирует синтетический 3D-рендер кота, после чего начнёт комбинировать серию моделей для создания трёхмерного объекта. Сначала будет создана грубая модель облака с 1024 точками, а затем более точная с 4096 точками. При этом сам объект непосредственно по описанию не создаётся.

Нейросеть обучена создавать 3D-модели на основе анализа миллионов трехмерных изображений, все они были преобразованы в стандартизированный формат. Команда разработчиков признает, что по качеству готовые работы уступают некоторым технологиям конкурентов, но зато образцы можно создавать очень быстро. Любой желающий может оценить код модели на GitHub.