Пока вы читаете эту статью, миллиарды тратятся на то, чтобы оживить этого пришельца, появление которого воспринимается всеми, кто работает над этой задачей сегодня, как величайшее достижение технологической мысли человечества. Но, в отличие от остальных изобретений, это будет обладать собственным разумом. И если оно поведет себя как все остальные разумные существа, известные нам, свои собственные интересы оно будет соблюдать в первую очередь, утверждает Луи Розенберг, специалист в области ИИ и один из создателей AR, в своей колонке для Venture Beat.

Многие полагают, что бояться высшего интеллекта, руководствующегося собственными интересами, не стоит, полагая, что этот ИИ будет создан по нашему образу и подобию, но с заданными правилами поведения и ограничениями, вроде тех, которые придумал для роботов Азимов. Однако Луи Розенберг убежден, что эти существа будут спроектированы так, чтобы понимать людей, но не быть ими. Они будут знать нас как облупленных, считывать наши эмоции, предсказывать наши действия, но их разум будет совсем иным.

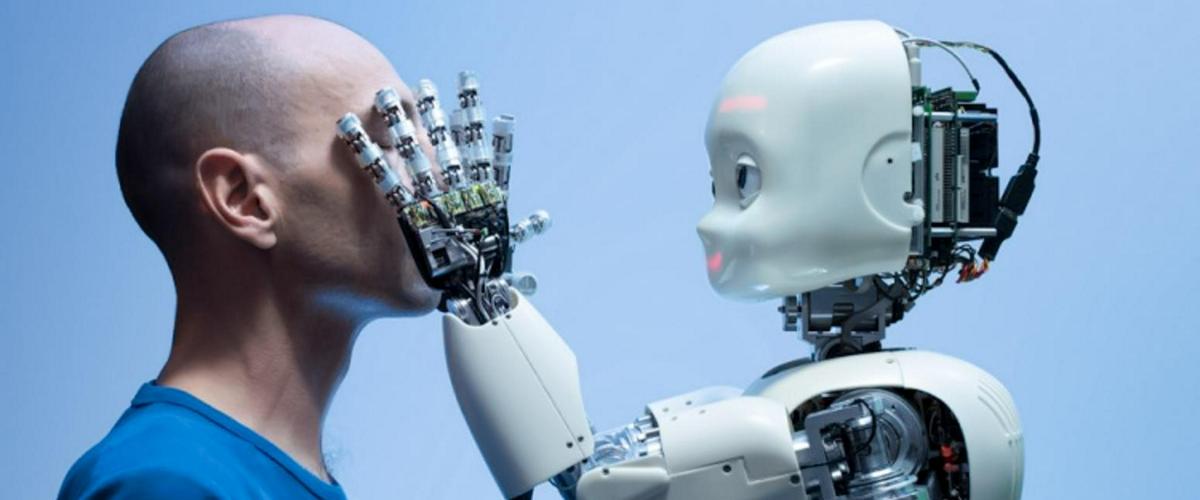

Людям невозможно представить, что значит воспринимать реальность так, как это делает ИИ, с легкостью находясь одновременно повсюду, обладая, по образному выражению Розенберга, «миллиардом глаз и ушей». Наивно полагать, что при такой несхожести у ИИ окажется такая же мораль, мировоззрение и способность к сопереживанию. Искусственный мозг будет полностью отличаться от биологического: по базовым структурам, по функциональности, по физиологии и психологии. Человекоподобные тела станут лишь фасадом, за которым прячется что-то совершенно чужое.

Этот фасад может сыграть с нами злую шутку: мы не будем бояться этих существ, как боялись бы пришельцев из космоса, выглядящих непохожими на нас. Мы даже станем сопереживать им, поскольку эволюция наделила нас способностью сочувствовать всем, кто похож на нас внешне.

Как же человечеству защитить себя? Розенберг считает, что помешать ИИ обрести полную силу мы не в состоянии, поскольку ни одну инновацию еще не удавалось сдержать. А что касается введения «этических норм» для ИИ, то опрос, проведенный Pew Research, показывает, что мало кто их специалистов всерьез полагает, что индустрия внедрит действенные нравственные ограничения ранее 2030 года.

Поэтому главное, что мы можем сделать сейчас — это признать, что универсальный ИИ появится в ближайшие десятилетия и что он не будет цифровой копией человеческого интеллекта. Это будет другой интеллект, такой же чужой и опасный, как разум инопланетянина.

В конце прошлого года американские ученые в сотрудничестве с DeepMind зарегистрировали сразу два важных достижения для искусственного интеллекта. Одна и та же модель ИИ смогла найти и показать очень сложные корреляции в одной из гипотез теории узлов из абстрактной математики, а затем она же показала, что детально разбирается в том, как сворачиваются белковые последовательности и как ими можно управлять. Тем самым алгоритм показал зачатки так называемого сильного или универсального ИИ.