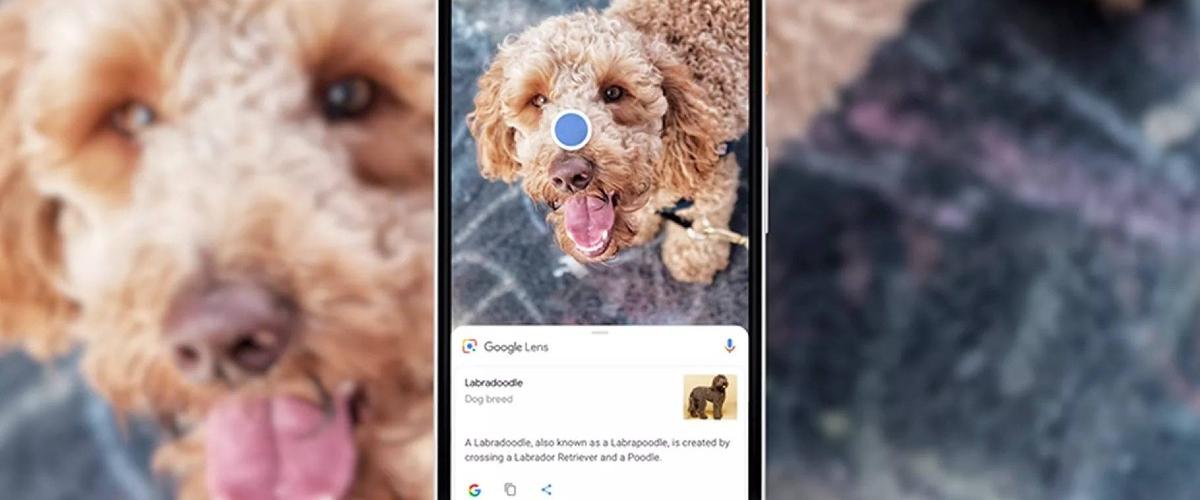

Google Lens, используя камеру смартфона, может сканировать тексты, распознавать и переводить их, помогает решать математические задачи, искать похожий объект в интернете и т. д. MUM в состоянии одновременно понимать смысловую нагрузку по тексту, изображению и видео, находить взаимосвязи между разными сообщениями.

Благодаря связке MUM и Google Lens решение обогатится текстово-визуальным поиском прямо в браузере. Например, пользователю понравилась фотография рубашки с определенным рисунком. Добавив несколько текстовых описаний вручную и нажав на специальную кнопку, с помощью Google Lens можно будет найти вещи с таким же рисунком (от рубашки до носков), заодно Google подскажет, где их купить. Таким образом результаты поиска будут более релевантными.

Также Google предлагает использовать Google Lens для ремонта техники. Например, у велобайкера-любителя сломался велосипед. Он не знает, как называется поврежденная деталь. Байкер наводит камеру на сломанную запчасть, вводит в Google Lens текст «купить» или «как отремонтировать» и получает предложения по заказу детали в интернет-магазине или советы ее восстановлению.

Также MUM и Google Lens могут аналогичным образом работать в поиске по видео.

Обновление Google Lens с указанным функционалом появится в сторах приложений в ближайшее время, но, по словам разработчиков, решению потребуется «тщательное тестирование».