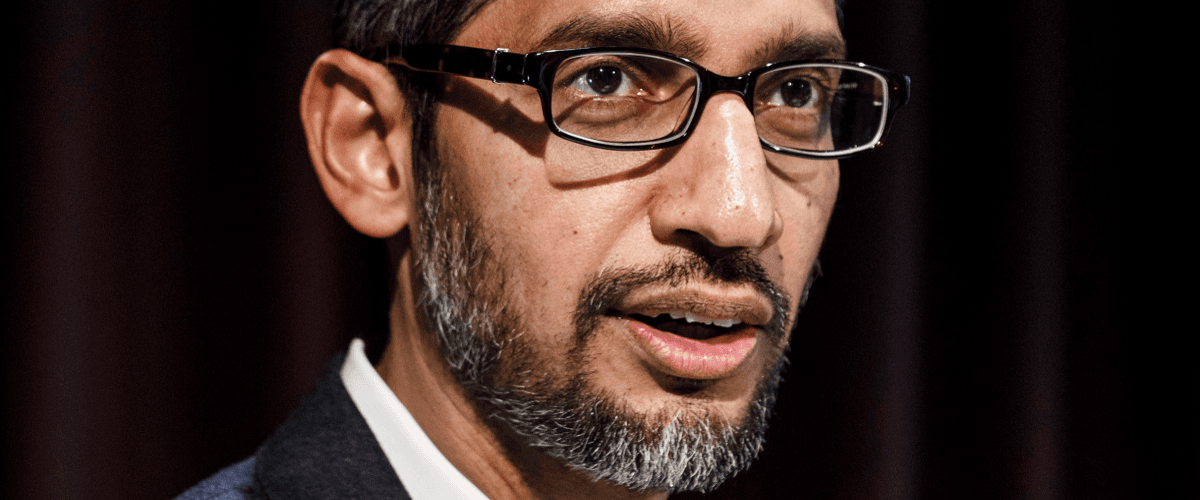

Глава Google Сундар Пичаи рассуждал о минусах регулирования ИИ в интервью Financial Times. Сейчас алармисты рассматривают ИИ как одно из опасных орудий в будущих конфликтах, а также опасаются выхода алгоритмов из-под контроля и восстания умных машин.

Пичаи уверен, что такие страхи провоцируют принятие поспешных решений, которые могут свести на нет потенциальные выгоды от использования машинного обучения. Как и многие другие топ-менеджеры, он уверен, что ИИ изменит все, что нас окружает — если ему позволят.

СЕО Google предлагает два подхода к эффективному регулированию — узкий и «вертикальный».

Разрабатывать новые законы для регулирования ИИ сейчас не нужно, уверен он.

Гораздо эффективнее смотреть на конкретные сектора и вносить новые элементы в законы, которые их уже регулируют. Два важнейших момента, которые нужно ограничить, не должны затрагивать саму технологию, призывает он. Однако необходимо обеспечить сбалансированность наборов данных, которые используются для обучения, а также прозрачность вынесения решений.

«Это широкая сквозная технология, поэтому важно уделять больше внимания [регулированию] в определенных вертикальных ситуациях. Вместо того, чтобы торопиться с [законами], которые помешают инновациям и исследованиям, вам на деле нужно лишь решить некоторые сложные проблемы», — подчеркивает он.

Как замечает Business Insider, поиск баланса в развитии ИИ важен и для самой компании. Google считает ИИ важнейшей из технологий будущего, но уже столкнулся с противодействием собственных сотрудников, когда начал сотрудничать с Пентагоном в рамках Project Maven. От выгодного соглашения пришлось отказаться, а в компании появился первый кодекс разработки ИИ. В нем семь заповедей и четыре запрета.

Интересно, что позицию Пичаи поддержала Лора Нолан — экс-инженер Google, которая уволилась из компании из-за этического конфликта, опасаясь использования своих наработок в будущих войнах. В комментарии для BI она заявила, что Сундар исходит из корпоративных интересов. Однако она также убеждена, что тотальными запретами и ограничениями можно, скорее, навредить человечеству, нежели обезопасить его.