ВОЗ опубликовала отчет, описывающий новые рекомендации по большим мультимодальным моделям (LMM). По мнению организации, важно, чтобы использование технологий определялось не только технологическими компаниями и компаниями из богатых стран. Если модели не обучены на данных людей из мест с ограниченными ресурсами, эти группы населения могут плохо обслуживаться алгоритмами.

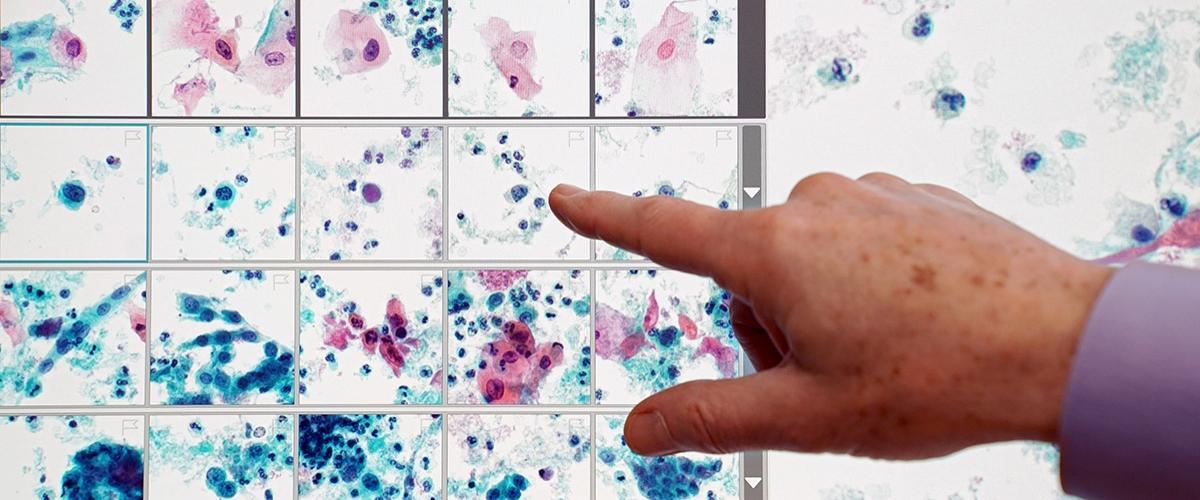

Организация выпустила свои первые рекомендации по использованию ИИ в здравоохранении в 2021 году. Однако менее чем через три года она была вынуждена обновить их из-за роста мощности и доступности LMM. Эти модели, также называемые генеративным искусственным интеллектом, обрабатывают и создают текст, видео и изображения. LMM были приняты быстрее, чем любое потребительское приложение в истории, и здравоохранение не осталось в стороне. Модели могут составлять клинические записи, заполнять формы и помогать врачам диагностировать и лечить пациентов. Несколько компаний и поставщиков медицинских услуг разрабатывают специальные инструменты искусственного интеллекта.

Есть риск, что компании, стремясь первыми выпустить приложения, могут предоставлять небезопасные и неэффективные инструменты. Это может привести к циклу дезинформацию, в котором LMM, обученные на неточной или ложной информации, загрязняют публичные источники информации, например, интернет.

ВОЗ предупреждает, что использование этих мощных инструментов не должно быть оставлено только на усмотрение технологических компаний. Правительства всех стран должны совместно возглавить усилия по эффективному регулированию разработки и использования технологий искусственного интеллекта. Гражданское общество и люди, получающие медицинскую помощь, должны внести свой вклад во все этапы разработки и внедрения LMM, включая их надзор и регулирование.

В своем отчете ВОЗ предупреждает о возможности «промышленного захвата» развития LMM, учитывая высокую стоимость обучения, развертывания и поддержания этих программ. Уже есть убедительные доказательства того, что крупнейшие компании вытесняют как университеты, так и правительства в исследованиях ИИ, при этом беспрецедентное количество ученых и преподавателей покидают академические круги ради промышленности.

В руководящих принципах рекомендуется, чтобы независимые третьи стороны проводили и публиковали обязательные проверки после выпуска LMM, которые развернуты в больших масштабах. Такие проверки должны оценить, насколько хорошо инструмент защищает как данные, так и права человека. Разработчики, создающие мощные мультимодальные модели для здравоохранения и научных исследований, должны пройти обучение по этике, сравнимое с обучением медицинского персонала. Также отмечается, что правительства могут требовать от разработчиков регистрации ранних алгоритмов, чтобы поощрять публикацию отрицательных результатов и предотвращать предвзятость и ажиотаж в публикациях.