Эволюция ИИ

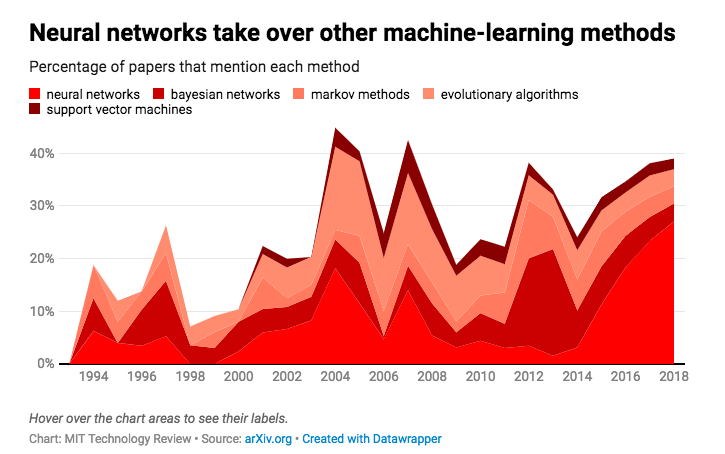

Аналитики Массачусетского технологического института (США) проанализировали более 16 600 исследований в области искусственного интеллекта, выложенных на сайте arXiv с 1993 по ноябрь 2018 года. Эксперты подсчитали, какие ключевые слова чаще всего упоминались в научных работах в разные периоды.

Оказалось, что каждое десятилетие главное направление научной мысли в сфере ИИ менялось.

Так, в конце 90-х и начале 2000-х о машинном обучении стали говорить чаще, чем когда-либо прежде. В 2010-х на передний план вышли нейросети, которые в последнее время стали использовать для обучения с подкреплением.

Долгое время интерес у исследователей вызывали системы, основанные на знаниях (KBS), также известные как экспертные системы. Программы такого типа подчиняются строгому набору правил, который позволяет в цифровой форме зашифровывать сумму человеческих знаний и представлений о мире.

В начале 2000-х в научных работах все еще часто упоминали «логику», «правила» и «ограничения» — необходимые условия функционирования KBS.

Однако оказалось, что для нормальной работы машины требуется зашифровать слишком много правил, что в конечном итоге оказалось контрпродуктивным.

KBS стали уходить в прошлое, а им на смену пришли алгоритмы машинного обучения, которые самостоятельно находят ценные сведения в массиве данных.

Первое время исследователи экспериментировали. В тот период многие увлеклись Байесовскими сетями и методом опорных векторов, а также эволюционными алгоритмами.

Но наибольшую популярность приобрели системы на базе глубокого обучения, в первую очередь нейросети. С помощью статистики они находят паттерны в наборе данных и учатся анализировать окружающий мир. Именно глубокое обучение наделяет ИИ зрением и слухом, а в некоторых случаях и умением логически мыслить.

Эта технология лежит в основе поискового механизма Google, новостной ленты Facebook и системы рекомендаций Netflix, поэтому сейчас она кажется нам главным драйвером технологий искусственного интеллекта.

Судя по статистике упоминаний на arXiv, исследователи сделают ставку на обучение с подкреплением — методику, которая напоминает дрессировку животных. ИИ поощряют за корректное решение и наказывают за ошибочное суждение. Таким образом программа усваивает знания и учится самостоятельно искать ответы на поставленные вопросы.

В MIT считают, что главным драйвером роста обучения с подкреплением стала победа алгоритма AlphaGo от DeepMind над мировым чемпионом по игре в го.

Новые парадигмы

Однако постепенно практики глубокого обучения утратят свое влияние. По мнению профессора компьютерных наук Педро Домингоса, это естественный процесс развития технологий ИИ.

Эксперт полагает, что в 2020-е привычные методы тренировки алгоритмов отойдут на второй план.

При этом сейчас с уверенностью сказать, как именно будет развиваться ИИ в ближайшие десятилетия, никто не может. «Если вы ответите на этот вопрос, то я ваш ответ тут же запатентую», — отметил Домингос. Не исключено, что на сцену вернутся забытые методики или же появится совершенно новый подход, который даст толчок всей индустрии.

Специалисты лаборатории DeepMind уже разочаровались в возможностях глубокого обучения. По их мнению, нейросети не позволяют искусственному интеллекту мыслить, как человек. Существующие системы получают все более широкое распространение, поскольку данные и вычислительные мощности становятся все более доступными. Но фундаментальные проблемы ИИ до сих пор не решены, объясняют они.

В качестве альтернативы DeepMind предлагает опереться на графовые сети, которые начали применять еще в конце 90-х годов.